L’intelligence artificielle a transformé des pans entiers de la société et de l’économie. Pourtant, les inconvénients de l’intelligence artificielle restent nombreux — et souvent mal compris. Avant de parier sur l’IA pour optimiser un processus, il vaut mieux bien cerner ses risques, ses limites et ses zones d’ombre.

1. Les inconvénients de l’intelligence artificielle : réponse rapide

L’IA pose des problèmes techniques, éthiques, économiques et sociaux importants. En particulier : manque de transparence, risques de biais, dépendance aux données, nouvelles menaces sur l’emploi et difficulté d’audit.

2. Risque de biais et de discrimination

L’un des principaux inconvénients de l’intelligence artificielle concerne la reproduction (voire l’amplification) des biais humains. Si les données de départ sont biaisées, un algorithme apprendra ces biais et les appliquera sur tout nouveau cas.

3. Manque de transparence (boîte noire)

De nombreuses IA, et notamment le deep learning, fonctionnent comme des boîtes noires. Il est souvent presque impossible de comprendre pourquoi une décision a été prise.

Ça pose un vrai problème : comment corriger une décision injuste ou abusive si même les concepteurs ne savent pas expliquer le raisonnement de la machine ?

4. Dépendance aux données massives et à leur qualité

L’IA adore les données (beaucoup, et de qualité). Mais une collecte ou une utilisation imparfaite crée des erreurs, des dérapages, voire des conséquences graves sur la vie réelle.

Parfois, même le choix des sources ou leur interprétation posent problème. Cet enjeu est central pour tous les métiers qui manipulent le big data ou exploitent la data science au quotidien. D’ailleurs, pour découvrir les meilleures pratiques et certifications, notre article Big data certification détaille le sujet.

5. Emploi et transformation du travail

L’intelligence artificielle bouleverse déjà le marché de l’emploi. Certains métiers déclinent ou changent, tandis que d’autres émergent (voir Emploi en intelligence artificielle et Ingénieur en intelligence artificielle). Ce changement n’est pas neutre.

Pour certains secteurs, la vitesse de la mutation dépasse la capacité d’adaptation des salariés et des formations, ce qui pose des questions délicates sur l’inclusion et la précarité.

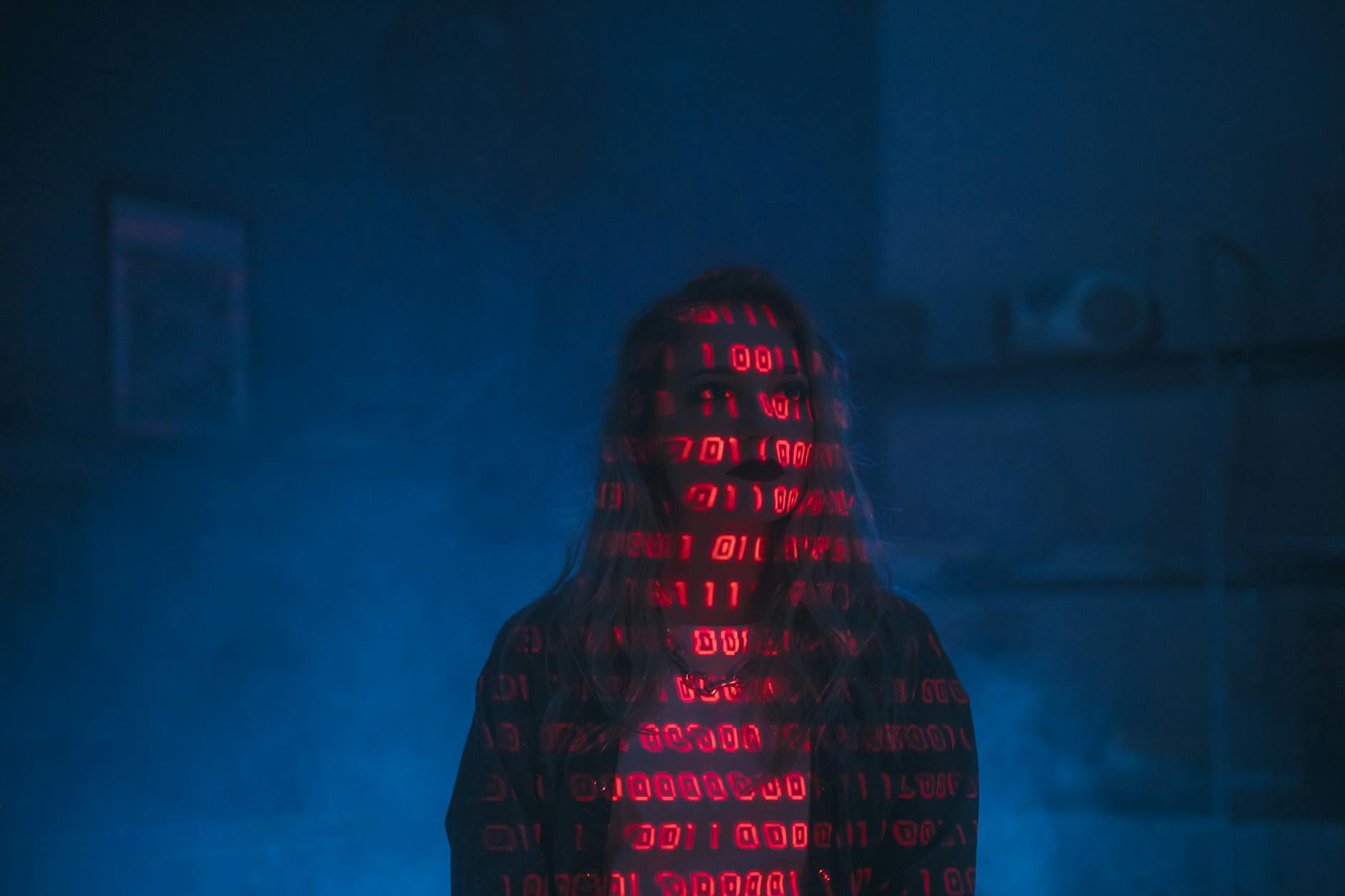

6. Cybermenaces et sécurité

L’IA ouvre aussi la voie à de nouveaux outils d’attaque : phishing perfectionné, deepfakes, attaques automatisées par des robots dotés d’intelligence artificielle (voir notre article Robot intelligence artificielle). Les systèmes IA sont parfois aussi vulnérables aux manipulations adverses (adversarial), qui détournent la machine de sa mission. Petite anecdote : certains chercheurs ont trompé un réseau de reconnaissance d’images en modifiant quelques pixels — le résultat, une banale photo de panda devenait « un gibbon » pour la machine.

7. Problèmes éthiques et juridiques

Responsabilité des décisions, respect de la vie privée, délégation à la machine, surveillance massive : chaque progrès s’accompagne de dilemmes. Les outils d’intelligence artificielle peuvent mener à des utilisations contraires à l’éthique ou difficiles à contrôler.

Qui doit répondre si une IA commet une erreur grave ? C’est souvent flou, ce qui freine l’adoption ou oblige à des béquilles réglementaires sur-mesure.

8. Coût, complexité et accessibilité

Développer, entretenir et mettre à jour une solution IA reste coûteux, tant en ressources humaines que matérielles. Les petites structures ou organisations peu technophiles sont tentées de se tourner vers des IA prêtes à l’emploi, ce qui peut créer une dépendance ou dégrader la qualité (voir Claude intelligence artificielle pour comprendre certains compromis).

9. Évolution perpétuelle : la course à l’IA parfaite

Le rythme d’évolution technologique impose d’être en veille constante et de se former régulièrement (vous pouvez consulter Veille stratégique à ce sujet). Parfois, on adopte au quotidien un outil qui sera obsolète ou dangereux quelques mois plus tard.

10. Évolutionnisme du risque : comment en est-on arrivé là ?

Au départ, l’IA devait résoudre des tâches répétitives et simples. Mais la sophistication croissante a aussi démultiplié la surface de risque. Autrefois, les risques se limitaient à de simples bugs ou à de la sur-optimisation d’un modèle statistique. Aujourd’hui, la boîte de Pandore éthique et sociétale s’est ouverte : piratage de données, procès pour perte d’emploi, crises de confiance, voire dérives autoritaires alimentées par la surveillance algorithmique.

Réduire les inconvénients de l’intelligence artificielle : quelques pistes

Aucune solution n’est parfaite. Cependant, on peut réduire les défauts de l’IA grâce à l’audit régulier des algorithmes, à l’explication des modèles (“IA explicable”), au monitoring constant et à la diversité des équipes de développement. La formation en intelligence collective aide aussi à intégrer des regards variés et à éviter les angles morts.

FAQ : les internautes demandent aussi…

- Quels sont les dangers principaux de l’intelligence artificielle ? Risques sur l’emploi, sur la vie privée, biais algorithmiques et attaques informatiques.

- L’IA remplacera-t-elle l’humain ? Pas totalement, mais elle change déjà la nature de certains métiers.

- Peut-on contrôler ou limiter l’IA ? Oui, grâce à la réglementation, à l’audit éthique et à la conception responsable.

Laisser un commentaire